Meine Conversion-Rate stagniert seit langem – Was tun?

Gehen wir von folgender Situation aus: Du hast eine Website und merkst, dass der Seitentraffic irgendwie nicht das macht, was Du Dir wünschst: Er konvertiert nicht. Wenn User:innen nicht kaufen, sich nicht zum Newsletter anmelden oder ein Kontaktformular nur bis zur Hälfte ausfüllen, dann ist das ein echter “Conversion-Killer” und gleichzeitig schlecht für das Business.

Je besser der Funnel optimiert ist, umso höher Deine Chancen, dass Besucher:innen konvertieren und somit Konversions- und Klickrate steigen. Es ist schon lange kein Geheimnis mehr, dass gute Usability einen ausschlaggebenden sowie aussagekräftigen Effekt auf die Verkaufszahlen hat. Eine Optimierung der Conversion Rate bedeutet daher für Dich, an den richtigen Stellschrauben für die Umsatzsteigerung zu drehen.

Wie bringt man User:innen also zum gewünschten Klick? Eine Möglichkeit Deinen Conversion Funnel und damit auch Deine Konversionsrate zu optimieren, ist folgende Testmethode: das A/B-Testing (auch Split-Testing genannt). Es zählt zu den gängigsten Methoden im Prozess der Conversion Rate Optimization (CRO).

Was ist A/B-Testing?

A/B-Testing ist eine Methode, die häufig in der Web- und Marketingindustrie eingesetzt wird, um die Wirksamkeit von Änderungen an einer Website, einer Anzeige oder einer Marketingkampagne zu testen. Dies kann das Layout Deiner Seite betreffen, die Formulierung der Calls-to-Action auf bestimmten Buttons oder viele weitere Merkmale Deiner Webseite.

Bei einem klassischem A/B-Test wird eine Zielgruppe in zwei gleich große Gruppen aufgeteilt: Eine Gruppe erhält die originale Version (A), während die andere Gruppe die veränderte (manipulierte) Version (B) erhält. Dann wird das Verhalten beider Gruppen über einen bestimmten Zeitraum verfolgt und gemessen, um festzustellen, welche Version besser abschneidet.

Das Ziel von A/B-Testing besteht darin, anhand von messbaren Daten herauszufinden, welche Änderungen auf Deiner Website einen messbaren Erfolg für die Funnel-Optimierung und UX bringen (z.B. Kaufabschlüsse, Klicks auf Buttons, Anmeldungen usw.). Wenn eine Version signifikant besser abschneidet als die andere, kann die Gewinner-Version ausgewählt und dauerhaft implementiert werden, um die Converion Rate zu verbessern.

Die Daten sind qualitativ hochwertig und aussagekräftiger als manche Kundenbefragung oder gar das Handeln nach dem Zufallsprinzip. Dafür gibt es ein schlagendes Argument: Die Art und Weise, in der die Daten erhoben werden.

Es handelt sich nicht um eine introspektive Methode, d.h., um bewusst abgefragte Informationen aus den Informationsspeichern des Gehirns. A/B-Testing als Optimierungsinstrument funktioniert deshalb, weil unbewusste Verhaltens- und Entscheidungsmuster erfasst werden.

Wie schaut das A/B-Testing in der (Online) Praxis aus?

Deinen Websitebesucher:innen werden während des Testings zwei Varianten der gleichen Website ausgespielt. Dabei sieht eine Gruppe der Besucher die Originalversion und die andere Gruppe eine veränderte Variante der Seite bzw. des Elements der Seite, welches getestet werden soll.

Die Effekte werden gemessen und verglichen, um festzustellen, welche Variation des Split Tests mehr Conversions bzw. auch Interaktionen erzeugt. In der Regel ist die Variation mit der höheren Conversion Rate die Gewinnervariante.

Achte bei der Erstellung deiner Stichprobe auch auf die Stichprobengröße deines Split Tests, um eine Schlussfolgerung ziehen zu können. Diese Erkenntnisse solltest Du natürlich nutzen, um Deine Website entsprechend zu optimieren. Damit die Erkenntnisse Deiner Stichprobe auch statistisch valide sind und Du darauf vertrauen kannst, wird eine Signifikanz der Ergebnisse berechnet. In der Praxis gilt eine Signifikanz von über 95% als statistisch signifikant.

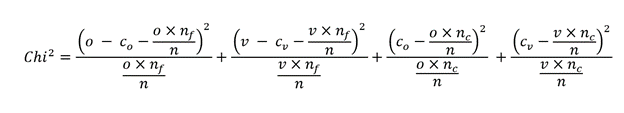

Die Signifikanz ergibt sich aus dem Chi-Quadrat-Test (Quelle: wikipedia.org). Die Formel hierfür lautet:

Die innerhalb der Formel genannten Variablen sind folgende Messgrößen:

o: Besuche der Original-Seite

v: Besuche der Variante

c_o: Conversions der Original-Seite

c_v: Conversions der Variante

n: Gesamtzahl Besuche

n_f: Gesamtanzahl Besuche ohne Conversion

n_c: Gesamtanzahl Besuche mit Conversion

Außerdem gilt:

n = o+v

n_f= n-(c_o+c_v)

n_(c )=(c_o+c_v)

Mit dem Chi-Quadrat-Test überprüfst Du, ob sich die relative Conversion Rate der Besucher:innen, die die Variation der Seite angezeigt bekommen, signifikant von der relativen Conversion Rate der Zielgruppe unterscheidet, die die Originalversion der Seite angezeigt bekommen.

Alternativ empfehlen wir Dir auf einen Signifikanzrechner zurückzugreifen. Er ist ein nützliches Tool für Split-Tests. Welcher sich hierfür eignet, erfährst Du im Abschnitt “Wie lange soll ich testen?”

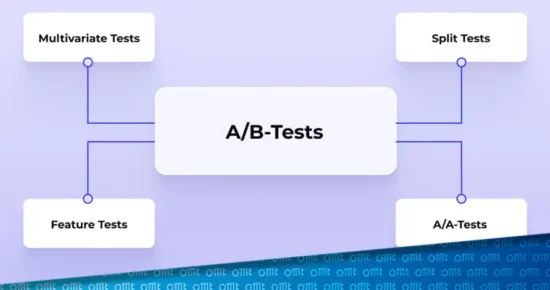

Arten von A/B Tests

Es gibt verschiedene Arten von A/B Tests. Die gängigen Testmethoden sind:

- A/B- oder A/B/n-Tests

Mit A/B-Tests oder A/B/n-Tests lassen sich zwei oder mehr Varianten derselben Website gegeneinander testen. So findest Du schnell heraus, welche Website bei Deinen Nutzern am besten ankommt. Bedenke, dass Dein Traffic mit jeder Variante aufgeteilt wird und es dadurch länger dauert zu einem signifikantem Ergebnis bei der Analyse und Auswertung zu kommen.

- Multivariate Tests

Mit multivariaten Tests kannst Du mehrere Elemente auf einer Seite gleichzeitig ausprobieren, um herauszufinden, mit welcher Kombination Du die besseren Ergebnisse erzielst. Diese Testmethode ist geeignet um mehrere Elemente parallel auf deren Erfolg hin zu testen.

- Weiterleitungstests

Weiterleitungstests, (auch bekannt als Test mit verschiedenen URLs), sind A/B-Tests, bei denen Websiten miteinander verglichen werden. Dabei werden beide Varianten einer Seite erstellt, über eine dedizierte URL verfügbar gemacht und ein A/B Testing Tool entscheidet dann, auf welche Variante der User weitergeleitet wird. Das ist besonders nützlich, wenn Du zwei sehr unterschiedliche Landingpages oder ein komplettes Neudesign der Seite testen möchtest und gibt dir als Content Manager oder Developer mehr Flexibilität die Varianten in Deinem CMS oder Deiner Platftorm zu erstellen.

- Serverseitige Tests

Die meisten A/B Testing Tools arbeiten mit DOM Manipulation. Dabei wird Deine Seite nachträglich mit Java-Script “manipuliert.” Bei Serverseitigen Tests wird die Variation im Backend-Layer Deiner Website erstellt und von diesem gleich die Variante ausgespielt, die der User sehen soll. Diese Methode wird immer populärer aufgrund der Performance-Einbußen, die DOM-Manipulation mit sich bringt.

Eine Variante Deiner Seite, die einem/r vorab definierten Besucher:in oder Kundensegment zugewiesen wird. Üblicherweise bekommt das Segment diese Variante immer zu sehen.

Die Vorteile des A/B-Testings auf einen Blick:

→ Pain Points Deiner Website-Besucher lösen

→ Dein ROI steigt – Mehr Conversions bei kleineren Investitionen

→ Reduzierung Deiner Bounce Rates

→ Änderungen Deiner Website ohne großes Risiko

→ Data-Driven und Hypothesen-getrieben

→ Statistisch signifikante Ergebnisse

→ Profitables Redesign Deiner Website

Wie wird getestet und was kann getestet werden?

Grundsätzlich kannst Du alles testen, aber nicht jede Fragestellung und Hypothese eignet sich für die Tests. Daher ist es wichtig, dass Du eine klare Vorstellung von den zu Testenden besitzt, sowie davon, was Du erreichen möchtest, und die Sache mit einer entsprechenden Strategie angehst, wenn Du langfristig A/B Testing als Teil Deiner Marketing- oder Produkt-Strategie nutzen willst. Die Metriken für die Messung der Conversion und derer, die auf die Conversion einzahlen; sind für jede Website einzigartig.

Im E-Commerce kann das der Verkauf eines Produktes sein, während Maßnahmen im B2B häufig auf die Generierung von qualifizierten Leads ausgerichtet sind. Unabhängig von den branchenspezifischen Metriken gilt für alle Bereiche jedoch: A/B-Tests sollten immer zielgruppen- und problemorientiert durchgeführt werden.

Die so gewonnenen Erkenntnisse über Deine Zielgruppe können Dir gleichzeitig später für die Planung und Aussteuerung von Marketing- und Entwicklungsmaßnahmen nützlich sein.

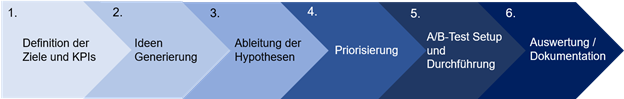

Wie funktioniert A/B-Testing? Dieser Workflow und Assets helfen Dir bei Deinem CRO & Testing Prozess!

A/B-Testing ist ein systematisches Vorgehen, um herauszufinden, ob eine bestimmte Maßnahme den gewünschten Erfolg erzielt. Bevor Du beginnst ins Blaue zu optimieren, versuche es mit einem strukturierten A/B-Testing-Programm, um Deine vorhandenen Marketing Bemühungen profitabler zu machen. Ja, richtig gelesen “Programm.”

A/B-Tests entwickeln sich von einer einmaligen Aktivität zu einer strukturierten und kontinuierlichen Aktivität.

Dabei sollte immer eine Frage im Mittelpunkt stehen: “Wie kann ich meinen Kunden das beste Erlebnis liefern?”

Dem ganzen Zauber liegt ein gut definierter Prozess zugrunde, der folgende Schritte umfasst:

5. A/B-Test Setup und Durchführung

6. Auswertung und Dokumentation

Bei den Punkten 2-6 handelt es sich um iterative Prozesse. Aus den Ergebnissen von Tests ergeben sich oft Ideen für weitere Tests.

Ziele und KPIs definieren

Bevor man einen A/B-Testplan erstellt, sollte man erst den Ist-Stand der Website erfassen. Hierfür solltest Du Daten darüber sammeln, wie viele Benutzer auf die Website kommen, welche Klickrate es gibt, wie hoch die Absprungrate ist, welche Seiten den meisten Traffic bringen und auch, welches die verschiedenen Conversion-Ziele der verschiedenen Seiten sind. So bekommst Du erstmal einen Überblick über das Potential und kannst entsprechend Deine Strategie definieren.

Es kann auch nicht schaden einen Blick nach links und rechts zu werfen. Daher schau Dir die Seiten Deiner Konkurrenten und Best Practices der Branche an. Was dort gut funktioniert, kann womöglich auch für Dich eine Chance sein.

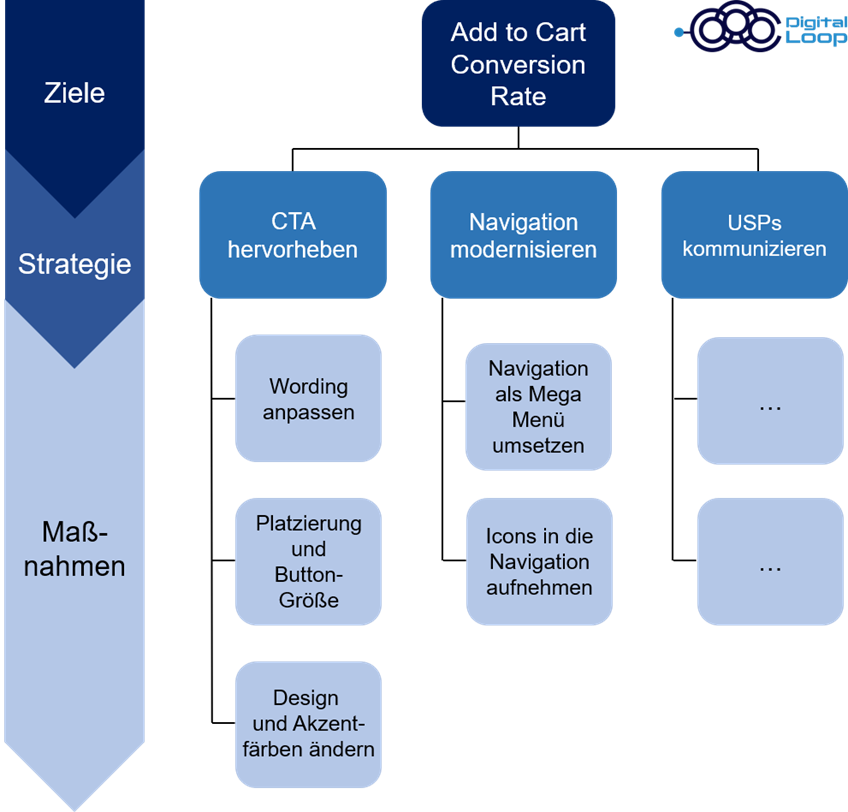

Die Grafik verdeutlicht am Beispiel der Metrik “Add to Cart”, die vorab identifiziert wurde als Metrik, die in das Unternehmensziel eines Online Shops (Umsatz zu generieren) einzahlt, wie daraus Strategien und Maßnahmen strukturiert abgeleitet werden, um “Add to Cart” zu erhöhen.

Grundsätzliche Fragestellungen, um Missstände im Conversion Funnel zu definieren: Wen verliere ich? (Zielgruppe), Wo verliere ich sie? (z.B. im Warenkorb)

2. Ideen Generierung

Die Ideen-Generierung geschieht bestenfalls in einem heterogenen Team von verschiedenen Personen aus den Abteilungen Deines Unternehmens. Dadurch stellst Du sicher, dass im Hinblick auf das A/B Testing verschiedene Perspektiven und Denkansätze in die Ideenfindung und Methodik einfließen.

Habt Ihr Euch erstmal im Team zusammengefunden, könnt Ihr über verschiedene Methoden an die Ideengenerierung herangehen: ganz klassisch über ein Brainstorming, Kartenabfrage oder Ähnlichem, vom Wettbewerb inspirieren lassen, von vorherigen A/B Tests oder durchgeführten (qualitative und quantitative) Analysen. Insbesondere die qualitativen Analysen sind ein mächtiges Werkzeug für das A/B Testing: Die quantitativen Analysen (Google Analytics und Co.) helfen zu identifizieren, wo es Probleme auf der Website gibt, wie z.B. hohe Ausstiegsraten im Checkout. Sie können aber nur begrenzt helfen, zu verstehen, wieso das so ist, wobei die qualitativen Analysen wie Heatmaps, Screenrecoridngs, User Tests etc. besser dafür geeignet sind.

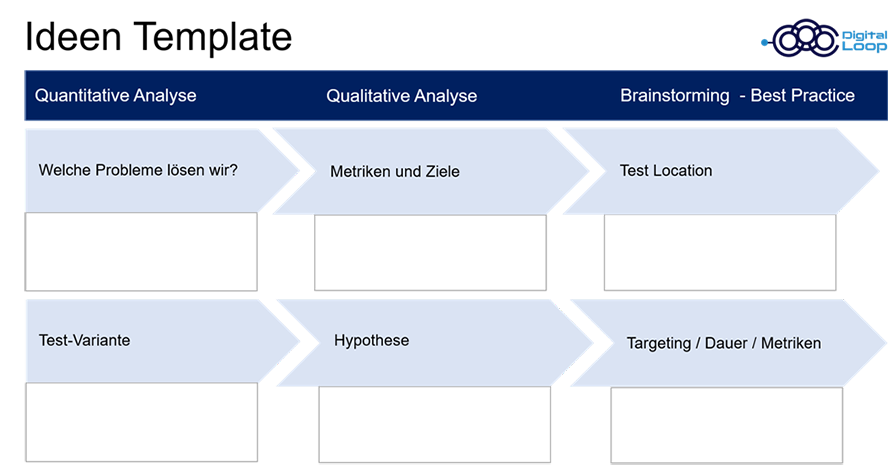

Unterstützend dazu kannst Du folgendes Template nutzen, um wichtige Fragestellungen für Deine Ideen vorab zu beantworten:

Typische Tools zur quantitativen Analyse:

- Google Analytics

- Adobe Analytics

- Omniture

- Mixpanel

Die Tools erleichtern es Dir, die meistbesuchten Seiten, Seiten mit der höchsten Verweildauer oder Seiten mit der höchsten Absprungrate zu lokalisieren. Du könntest zum Beispiel die Seite mit der höchsten Ausstiegsrate, aber hohen Traffic zuerst in Angriff für deine Optimierung nehmen.

Wenn das Problem identifiziert wurde, solltest Du punktuell etwas tiefer in die Analyse gehen. Qualitative Daten kannst Du am besten über bewährte Methoden wie Heatmaps, Mousetracking, Umfragen, Polls etc. erfassen und nutzen. Die Tools geben meist Heatmaps aus, mit denen Du feststellen kannst auf welcher Landingpages die Verweildauer Deiner Nutzer am höchsten ist und z.B. wie ihr Scrollverhalten und die Klickraten sind.

Wir empfehlen Dir, dass Du Deine Daten zusätzlich mit einem User Panel, also User Umfragedaten ergänzt. Umfragen können ein direkter Draht zwischen Dir und den Konsumenten sein und decken oft Probleme auf, die in den aggregierten Daten übersehen werden. So können gezielt Schlussfolgerungen getroffen werden.

Weitere qualitative Erkenntnisse lassen sich aus Algorithmen wie Session-Recordings ableiten. So können diese beispielsweise helfen Lücken in der User Journey zu identifizieren. Hier ist wieder zu beachten, dass keiner die Zeit hat, sich tausende Session-Recordings anzuschauen und man deshalb wirklich gezielt aufnehmen und schlussfolgern sollte.

Typisches Toolkit zur qualitativen Analyse:

Hotjar

Suite für Mousetracking, Heatmaps, Polls etc. (sehr gutes Preis-Leistungsverhältnis!)

Rapidusertests

Online User Tests managen

Contentsquare

Premium Suite für Mousetracking, Heatmaps, Surveys usw.

mPathy

Premium Suite für Mousetracking, Heatmaps, Surveys usw.

(hat den Vorteil, dass die Daten in Deutschland / EU bleiben)

Wie wir sehen, sind quantitative als auch qualitative Untersuchungen der Ausgangspunkt für die weiteren Schritte innerhalb eines typischen CRO-Prozesses. Sie bilden die fundierte Basis für die Ableitung der zu testenden Hypothesen.

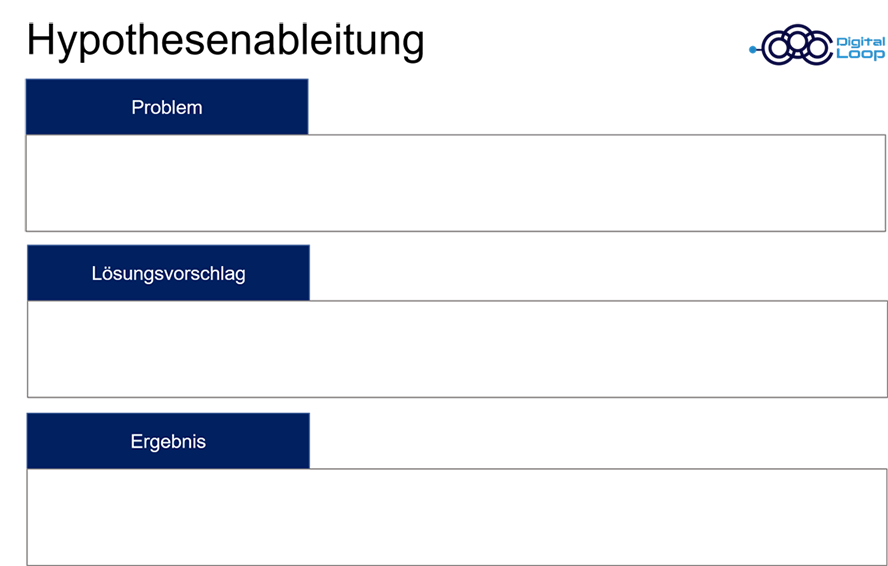

3. Ableitung der Hypothesen

Jede Idee, die als A/B Test umgesetzt werden soll, benötigt eine klare Hypothese.

Deine gesammelten Daten und Beobachtungen solltest Du nun nutzen, um datengestützte Hypothesen abzuleiten. Sie geben Deinem Testing die richtige Richtung vor und sind essentiell. Hierfür müssen Deine Daten jedoch richtig ausgewertet worden sein. Eine Hypothese für Dein Testing könnte zum Beispiel sein:

“Aktuell nehmen 90% unserer Besucher unser Newsletter-Widget nicht wahr. Wenn man den zusätzlichen Call-to-Action-Button “Zum Newsletter anmelden” auf die Homepage aufnimmt, werden 10% mehr Anmeldungen zum Newsletter generiert, weil die User die Anmeldung bereits beim Aufruf der Domain finden.”

Eine Hypothese zu erstellen, ist nicht so einfach für jeden Marketer und folgendes Template soll Dir dabei helfen, eine Hypothese zu schreiben. Eine gute Hypothese besteht aus einer Beschreibung des Problems, Lösungsvorschlag und dem erwarteten, messbaren Ergebnis.

Unter “Problem” definierst Du zunächst den “Ist-Stand”, das identifizierte Problem und stützt dies mit den Daten Deiner qualitativen und quantitativen Analysen.

Unter “Lösungsvorschlag” fasst Du Deine Ideen zusammen, die das Problem lösen können.

Dann formulierst Du das erwartete “Ergebnis” mit messbaren Metriken, z.B. Anteil der User, die etwas in den Warenkorb legen, wird um 10% erhöht.

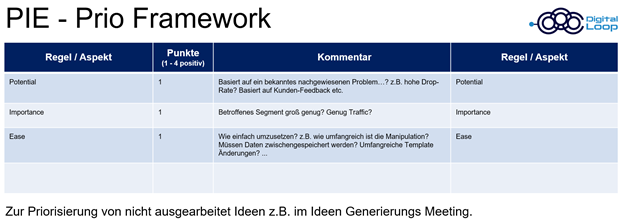

4. Priorisierung

Nachdem Du Deine Ideen gefunden und definiert hast, sollte nun in jedem Fall eine Priorisierung dieser erfolgen. Eine Eingrenzung ist wichtig, da Du für das A/B-Testing immer nur eine absehbare Anzahl an Maßnahmen vertesten kannst, insbesondere auf der selben Seite und auch der notwendige Aufwand berücksichtigt werden muss.Heißt: Du solltest die Ideen je nach Wichtigkeit sortieren und solche mit höchster Priorität als erstes in Angriff nehmen. Prioritäten kannst Du über Abgleich des erwarteten Einflusses, der Zielerreichung und dem geschätzten Aufwand der A/B-Testumsetzung sowie Ergebnisimplementierung ermitteln.

Deine Ideen kannst Du beispielsweise über das PIE Framework priorisieren. Das PIE Framework besteht aus den drei Kriterien Potential, Importance (Wichtigkeit) und Ease (Einfachheit).

Potenzial

Wie viel kann auf dieser Seite verbessert werden? Du solltest besonders die schlechtesten Performer hoch priorisieren.

Importance

Wie wertvoll ist der Traffic auf diese Seite? Deine wichtigsten Seiten sind diejenigen mit der höchsten Reichweite und dem teuersten Traffic. So hast Du vielleicht eine Seite gefunden, die sehr schlecht performt, aber keinen signifikanten Beitrag zum Traffic leistet. Diese Seite hat somit erstmal eine geringere Testpriorität.

Ease

Wie schwierig wird es sein, einen Test oder Testerkenntnisse auf dieser Seite zu implementieren? Die letzte Überlegung ist der Schwierigkeitsgrad der tatsächlichen Durchführung eines Tests auf dieser Seite, der die technische Implementierung und organisatorische wie auch politische Barrieren umfasst.

So vergibst Du nun je Ziel Punkte von z.B. 1 bis 4 für die drei Kriterien. Am Ende ermittelst Du den PIE-Score durch Addition der drei Punktzahlen. Dies wiederholst Du für jedes Deiner Ziele. Die Websiten mit den höchsten PIE-Scores werden entsprechend als erstes getestet.

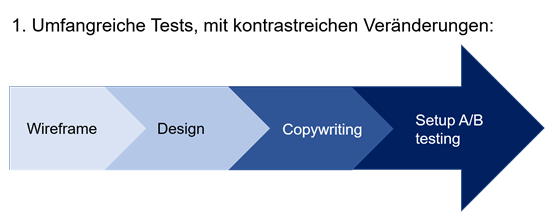

5. A/B-Test Setup und Durchführung

Im nächsten Schritt wird eine Variation erstellt, die auf Deiner Hypothese basiert. Die Hypothese wird in der Variation umgesetzt und gegen die bestehende Version (Kontrolle) getestet. Die Variation ist dabei die Änderung, die getestet werden soll. Es können mehrere Variationen erstellt werden, um zu sehen, welche am besten funktioniert.

Wichtig ist dabei, dass Du Dich pro Variation auf eine Änderung festlegst. Ansonsten kann es passieren, dass Du nach dem Test nicht mehr weißt, welche Änderung den gewünschten Effekt erzielt hat.

Was Du testest, hängt von Deiner Fragestellung und den Hypothesen ab.

Typische, schnelle Dinge, die man testet sind:

Typische, schnelle Dinge, die man testet sind:

- Headlines

- Texte

- Farben und Layout

- Navigation

- Bildersprache

- Kontaktformulare

- CTAs

- Social Proof

- Neue (geplante) Features

Für die Durchführung des Testings bestehen verschiedene Optionen. Für jeden A/B Test Manager oder CRO Manager empfiehlt es sich in der Lage zu sein, schnell Wireframes / Mockups etc. skizzieren zu können. Oft reicht ein einfaches Tool wie Paint schon aus, um die gewünschte Variante visuell verständlich zu machen.

Einfache Inhaltliche Änderungen lassen sich mit gängigen A/B Testing Tools über einen visuellen Editor selber einstellen, wobei größere Änderungen per DOM-Manipulation von einem Web Developer mit Javascript Skills durchgeführt werden können.

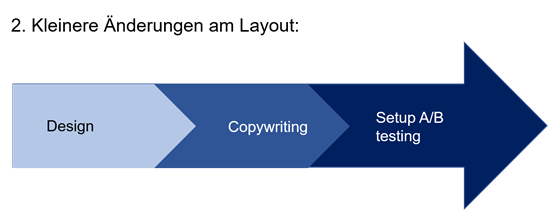

Je nach Optimierungsaufwand eignen sich verschiedene Testabläufe:

6. Auswertung und Dokumentation

Dieser Schritt klingt zunächst sehr einfach und wird deswegen schnell unterschätzt. Ich habe selten ein Unternehmen oder Team gesehen, das eine ordentliche Dokumentation über vergangene Tests und Ergebnisse hat. Wichtig ist hier, dass die Ergebnisse auch mit anderen Teams geteilt werden, damit diese in der laufenden Produktentwicklung, Website Ausbau etc. berücksichtigt wird und Fragen wie “welche Farbe für CTAs und Buttons” usw. nicht jedesmal von neu auftreten.

In einer Organisation, die schon weiter ist, werden ggf. Tests nicht mehr durchgeführt, weil man dafür Ergebnisse vergangener Tests heranziehen kann.

Viele Tools bieten eine Auswertung an, aber oft nicht so mächtig wie ein Web Analytics Tool wie Google Analytics, Adobe Analytics etc. Diese sorgen sogar dafür, dass Du die Ergebnisse auch dort messen kannst.

Tipp: Wenn Du Deine A/B Tests ausgewertet hast, schau Dir die Metriken auch für unterschiedliche Segmente an, da Durchschnittswerte oft Deine Entscheidungen falsch beeinflussen können. Es kann z.B. sein, dass Du einen Conversion-Uplift von 0% erzielst, aber dabei für mobile Besucher einen negativen Uplift von -5% und für Desktop User einen positiven Uplift von +5% hast. Im Durchschnitt wären das 0%, wobei daraus eine Personalisierungskampagne nur für Desktop User werden kann, die ja statistisch erwiesen mit einem Conversion-Uplift von +5% darauf reagiert haben. Diese Ergebnisse sind auch eine gute Basis für den Start von On-Page Personalisierungsmaßnahmen.

Wie lange soll ich testen?

Eine einfache Antwort gibt es hier nicht. Du solltest solange testen, bis die statistische Signifikanz erreicht wurde. In der Praxis wird eine Signifikanz von 95% angestrebt, damit die Testergebnisse aussagekräftig sind. (Quelle: biancahoegel.de). Da es mehrere Faktoren wie Traffic, Conversion Rate Uplift und Anzahl der Varianten gibt, um die notwendige Testzeit bis zur statistischen Signifikanz zu erreichen, solltest Du einen Laufzeitrechner wie diesen nutzen: A/B Tests Laufzeitrechner.

FAZIT: A/B-Testing ist eine einmalige Sache? Ein großer Denkfehler!

Auch nach der Optimierung bleibt stets Luft nach oben. Man sollte grundsätzlich so viel wie möglich testen und dabei auch kleine Änderungen, die schon eine große Wirkung haben können, auf der Website berücksichtigen. In der Praxis bei schon gut optimierten Websites hat man immer seltener den einen A/B Test, der einen großen Conversion-Uplift bringt – die Summe der A/B Tests machen den Erfolg aus.

Optimierungen sind nicht mit Redesigns und Relaunches gleichzusetzen, wo auf einen Schlag alles ausgewechselt wird, ohne zu wissen wie und welche Elemente sich positiv oder negativ auf den Besucher auswirken. Das kontinuierliche Testing ist notwendig, um die “Under Archivements” zu umgehen. Diese entstehen aufgrund von Brachzeiten.

Grundsatz: Je mehr A/B-Tests man macht, umso mehr mögliche Uplifts und Insights hat man. Dies spiegelt sich wiederum im Umsatz wider.

Weitere Leseempfehlungen zu dem Thema:

- A/B-Testing (Quelle: loyamo)

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen