Als „leblose Kopie der beseelten Sprache“ bezeichnete Platon einst die Schrift, die sich „seinen Adressaten nicht aussuchen“ könne und zudem „Klarheit und Vollständigkeit“ vermissen ließe. Was als Kritik an der fehlenden Tiefe, Missverständlichkeit und subjektiver Wahrnehmung gedruckter Texten formuliert wurde, hätte ebenso gut die Schnelllebigkeit des Internets und seiner Texte – die häufig mehr überflogen als gelesen werden – beschreiben können. Sprache ist der Schrift in vielen Punkten überlegen:

- Ein verbaler Dialog ist emotionaler und natürlicher als das geschriebene Wort

- Bedürfnisse können mit Sprache exakter artikuliert und definiert werden

- Nutzer sprechen im Schnitt dreimal so schnell, wie sie tippen

Hinzu kommt, dass Menschen – laut einer Untersuchung von Neuro Insights (www.jwtintelligence.com/trend-reports/speak-easy/) – bei gesprochenen Websuchen wesentlich entspannter sind, als bei denselben Suchen mittels einer Tastatur. Gleichzeitig ist die messbare emotionale Erregung bei der Aussprache einer Marke höher als beim Schreiben. Verkaufspsychologisch bietet Voice Commerce also alle Möglichkeiten, ein relevanter Absatzkanal zu werden. Allerdings sind viele Nutzer – ähnlich bei den Anfängen der Smartphonenutzung – noch skeptisch, was den Einkauf mittels Stimme angeht (vgl. Abbildung 1).

Unterschiede Sprachsuche vs. Websuche

Wer mit der Stimme sucht, formuliert oft ganze Sätze und Fragen, wie sie einem realen Menschen gegenübergestellt würden. Zudem wird der eigene Kontext (z. B. der eigene Standort) wie selbstverständlich in die eigene Suche mit einbezogen. („Wo ist hier in der Nähe die nächste geöffnete Apotheke?“ anstatt „Apotheke Berlin Tempelhof Öffnungszeiten“.) Wäre es möglich gewesen, dann hätten wir – so scheint es – das Internet schon immer mit Hilfe unserer Stimme bedient. Yariv Adan, Chefentwickler des Google Assistants, vermutet gar, dass uns eine viele größere Revolution bevorsteht, als jene des mobilen Webs durch Smartphone und Tablets: die Dauerpräsenz des Internets.

„This time, the connected device is not ‚just changing‘ – it’s disappearing all together. We are no longer interacting with a physical device, but rather with an ambient AI entity that can be accessed from… everywhere!”

Internet, immer und überall für alle

Durch die rasante Verbreitung von Smartphones hat inzwischen mehr als die Hälfte der Weltbevölkerung Zugang zum Internet und auch die vergleichsweise einfache Bedienung eines Tablets hat dazu geführt, sehr junge und ältere Menschen erstmalig online zu bringen. Die Sprachsuche ebnet nun den Weg für einen Personenkreis, dem die klassische Internetnutzung schwerfällt. Das Wallstreet Journal prognostiziert, dass die nächste Milliarde Internetnutzer vor allem ihre Stimme benutzen werden. Da viele Sprachanwendungen mangels Display keine visuelle Aufmerksamkeit benötigen und eine freihändige Bedienung ermöglichen, ergeben sich vollkommen neue Anwendungsszenarien z. B. im Auto, im Dunkeln oder beim Kochen.

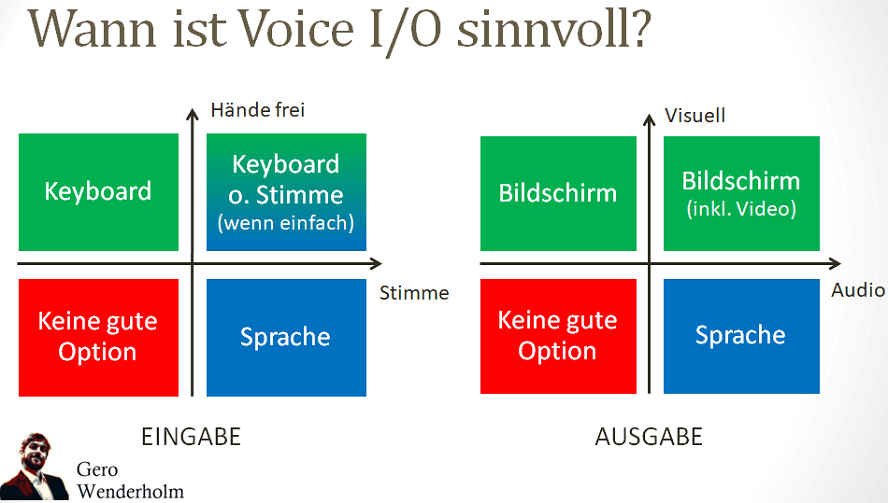

Abbildung 1: Eignungsschema für Voice I/O

Wer das eigene Angebot auf die Eignung für digitale Sprachsysteme überprüfen möchte, sollte ergo überlegen, welche Leistungen verbal möglicherweise komfortabler und schneller verfügbar gemacht werden können oder über Voice Schnittstelle vielleicht erstmals die notwendige Effektivität erzielen können. Denkt man beispielsweise an Radiowerbung, so ist die erzielte Aufmerksamkeit bislang eher schwierig direkt zu konvertieren. Mittels Voice Assistant – der auch in immer mehr Autos zu finden ist – wird dies nun möglich. Der Ausspruch „Alexa, bestelle Snoopy Hundefutter“, als unmittelbarer Reflex, liegt näher als ein spontaner Spurt zum Supermarkt.

OMT-Podcast mit Gero Wenderholm, Mario Jung

Voice Commerce – die Revolution des Online Handels – OMT-Podcast Folge #021

Was ändert sich durch Voice SEO

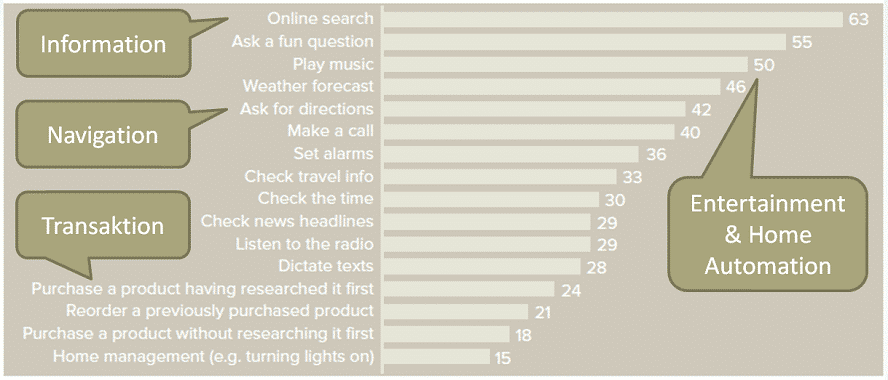

Laut Google soll zum Ende des Jahrzehnts jede zweite Websuche mittels Sprache erfolgen, sowohl über Mobiltelefone als auch mittels Sprachassistenten. Die Suchintentionen bei diesen Geräten unterscheiden sich dabei nicht besonders von denen bei der normalen Websuche: Auch hier geht es um informations-, navigations- und transaktionsgetriebene Suchen. Neben der Steuerung von Geräten und zur Unterhaltung, ist Informationsrecherche die meistgenutzte Funktion.

Abbildung 2: Wofür werden Sprachassistenten genutzt – Speak Easy Studie 2017

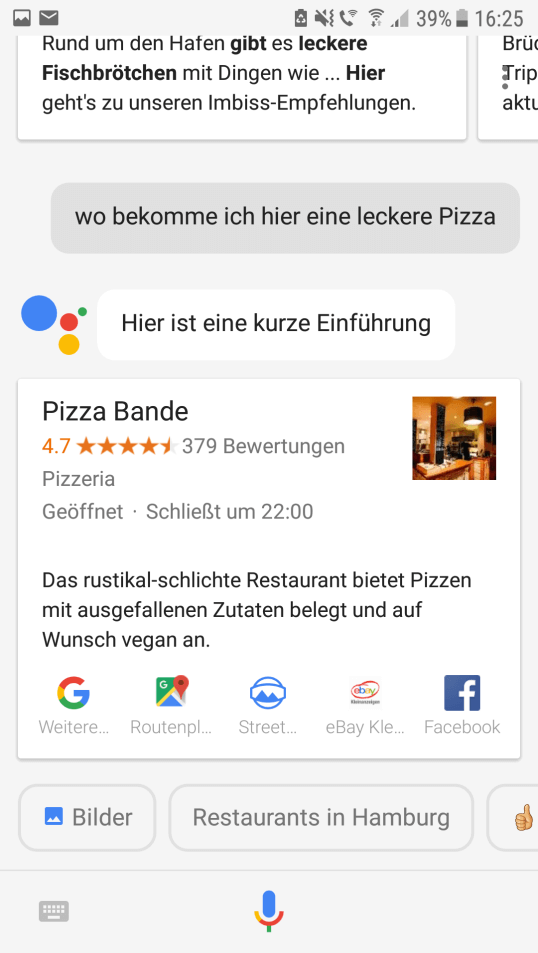

Bei der Antwortoptimierung für Assistenzsysteme – sprich: Voice SEO – gelten hingegen ganz andere, zum Teil gerätespezifische Regeln als bei der herkömmlichen Suchmaschinenoptimierung. Statt einer reinen Optimierung für Google, muss bei Voice Search beachtet werden, dass Amazons Alexa und Microsofts Cortana beispielsweise Bing als Quelle für ihre Antworten nutzen, die wiederum möglicherweise auf ganz andere Quellen zurückgreifen als Google. Bei der Alexa Suche nach einem guten Restaurant werden beispielsweise externe Plattformen wie Yelp oder TripAdvisor herangezogen, während Google eher dem eigenen Produkt MyBusiness vertraut. Wer dort nicht gelistet und gut bewertet ist, bleibt für die Sprachsuche möglicherweise unauffindbar, zumal im Gegensatz zu den zehn Ergebnissen der normalen Websuche oft nur ein einziges Ergebnis präsentiert bzw. vorgelesen wird.

Abbildung 3: Sprachsuche mit nur einem Ergebnis

Content SEO für Voice Search

Für Informationsgetriebene Sprachsuchen spielen die sogenannten „Featured Snippets“ – Anworten, die direkt in den Suchergebnissen eingeblendet werden – eine große Rolle, da diese von Sprachassistenten häufig vorgelesen werden. Auch die Auszeichnung der eigenen Webinhalte mit strukturierten Daten für Produkte, Events oder Fragen und Antwortbereiche bietet Vorteile. Sowohl für FAQ als auch zur Markierung explizit vorlesbarer Inhalte gibt es bereits Empfehlungen seitens Google:

https://developers.google.com/search/docs/data-types/speakable

https://developers.google.com/search/docs/data-types/qapage

Darüber hinaus hat Google Anfang des Jahres unter dem Titel „Evaluation of Search Speech – Guidelines“ eine Ergänzung zu ihren Quality Rater Guidelines veröffentlicht (storage.googleapis.com/guidelines-eyesfree/evaluation_of_search_speech_guidelines_v1.0.pdf), aus denen sich ableiten lässt, worauf es bei der Optimierung von Texten für eine optimale Sprachausgabe grundsätzlich ankommt:

- Wird die Frage des Nutzers komplett beantwortet?

- Ist die Länge der Antwort der Frage angemessen?

- Sind Formulierung und Grammatik korrekt und natürlich?

- Sind Aussprache und Rhetorik einwandfrei?

Punkt 4 meint dabei die flüssige Vorlesbarkeit eines Textes durch eine Maschine, die z. B. durch Abkürzungen oder komplexen Satzbau erschwert wird. Auch die tabellarische Darstellung von Inhalten, die für die optische Erfassung bestimmter Daten, z. B. bei Produktdetailseiten, bestens geeignet ist, mangelt es an Vorlesbarkeit. Hier kann es für Voice Optimierung Vorteile bieten, ein ausformuliertes Format zu wählen.

| Optisch leicht zu erfassendes Format | Sprachoptimiertes Format |

Handschmeichler „Ultrasoft“

|

„Das Handschmeichler Modell Ultrasoft ist in den Farben Orange, Pink und Ultramarin erhältlich. Mit einer Kantenlänge von 5 und einer Höhe von knapp 2 Zentimetern liegt er gut in der Hand. Die Herstellergarantie beträgt 36 Monate.“ |

Tabellarische vs. sprachoptimierte Darstellung

Sind Skills die neuen Apps!?

Software für Sprachassistenten sind vergleichbar mit den Apps für Handys. Für viele Einsatzzwecke gibt es in den jeweiligen Entwicklungsumgebungen fertige Vorlagen, die auf die eigenen Bedürfnisse angepasst werden können, sowie Schnittstellen für Logins, Käufe und den Datenaustausch mit dem eigenen Server.

Allerdings gelten für Konversationen – also einem wechselseitigen Gesprächspingpong – andere Regeln als bei der Navigation im Web. Aufeinander aufbauende, sich bedingende Anfragen, unterschiedlichste Ausdrucksmöglichkeiten derselben Intention sowie die Berücksichtigung persönlicher Vorlieben sind für die herkömmlicher Website UX fast unlösbare Hürden. Bei einem Gespräch mit einem Sprachassistenten erwartet der Nutzer zudem ein gewisses Maß an Empathie; die Frustgrenze ist hier sehr schnell erreicht.

Die Verwendung von Personas könnte ein Schlüssel zur Lösung dieses Emotionenproblems sein, seine Zielgruppe bei der Produktentwicklung eng einzubinden ein anderer. Google selbst nutzt Rollenspiele und Probanden dafür, die Konversation mit dem Assistant natürlicher werden zu lassen. Andere Firmen verwenden beispielsweise Call-Center-Aufzeichnungen, um typische Gesprächsverläufe zu analysieren.

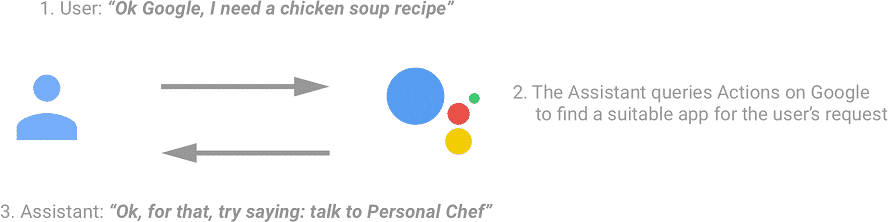

Chance: Implicit Invocation

Im Gegensatz zu Apps, die in aller Regel bei vorheriger Kenntnis des Appnamens im jeweiligen Store heruntergeladen werden müssen, kommt es bei Sprachassistenten vor, dass diese Nutzern mit einem bestimmten Vorhaben, selbst Vorschläge machen, welche Actions/Skills geeignet sein könnten.

Man spricht hier von „Implicit Invocation“ (vgl. Abbildung 4), eine Funktion, die sowohl der Google Assistant als auch Amazons Echo beherrscht. Auf eine Frage wie: „Ok Google, was ist das Besondere an einem Bohrhammer?“ könnte eine Antwort lauten: „Rede doch mal mit dem Werkzeugfuchs“ – so bekommen gute Anwendungen neue Nutzer, ohne große Anstrengungen, den eigenen Service einem breiten Publikum bekannt gemacht zu haben.

Abbildung 4: Impliziter Vorschlag einer Google Action – Quelle: Google.

Wer via Implicit Invocation berücksichtigt will, sollte laut Google folgende Ratschläge beherzigen:

- Informiere den Nutzer stets über seine Handlungsoptionen

- Vermeide Fehler und logische Ungereimtheiten

- Zwinge den Nutzer nicht früh zu einem Login oder der Eingabe sensibler Daten

- Vermeide offene Gesprächsenden und ermögliche Nachfragen und Rücksprünge

- Verwende aussagekräftige Aktivierungsphrasen

Des Weiteren sind folgende (unbestätigte) Rankingsignale für Sprachassistenten denkbar:

- Anzahl der Aktivierungen (+ ggf. Installationen)

- Nutzungsintensität: Frequenz, Dauer und wiederholte Nutzung

- Erfolgreiche Nutzungen sowie Abbrüche, Rücksprünge, Schleifen

- Performancemetriken für einzelne Intents (Teilfunktionen) der Anwendung

- Nutzerzufriedenheit – messbar über subtile Signale

Voice bietet bessere Informationen als bei der Webanalyse

Wer eine Lösung für Sprachassistenten anbietet, sollte diese sehr sorgfältig konzipieren, testen und ihren Erfolg messen. Publisher sollten sich bewusst sein, dass jede Voice Session eine Vielzahl an z. T. subtilen Signalen an den Anbieter (z. B. Amazon) liefert, die es bei der Webanalyse oder als bei der Suchmaschinenoptimierung nicht gibt, bzw. nicht eindeutig messbar sind.

Klickt ein Nutzer ziellos auf einer Webseite umher, freut sich der Analyst im Zweifel zu Unrecht über eine hohe Anzahl an Seitenaufrufen und eine lange Aufenthaltsdauer. Sprachassistenten bekommen hingegen mit, ob eine erfolgreiche Nutzung vorliegt. Bei einer zu geringen Erfolgsquote kann sich der Entwickler automatisch benachrichtigen lassen und dann anhand einzelner Konversationen überprüfen, welche Probleme ein einzelner Nutzer hatte.

Abbildung 5: Beispiel einer Konversation zwischen Nutzer und Skill.

Dass diese direkte Analyse eines Gesprächs möglich ist, wissen vermutlich die wenigsten Nutzer und wird sicher auch Datenschützer auf den Plan rufen. Für das Verständnis der Nutzerschaft und ihrer Bedürfnisse (ungefiltert, unverfälscht und detailliert) sind diese Daten hingegen Gold wert – nicht nur für die Optimierung der eigenen Sprachanwendung, sondern beispielsweise auch für die Verbesserung der eigenen Webseite.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen

Apple Podcasts

Apple Podcasts